_Long Short Term Memory.jpg)

حافظه طولانی کوتاه مدت

دسته : هوش مصنوعی

نویسنده : فاطمه تابع

تاریخ : 1402/12/26

سطح : پیشرفته

پست های مرتبط

حافظه طولانی کوتاه مدت

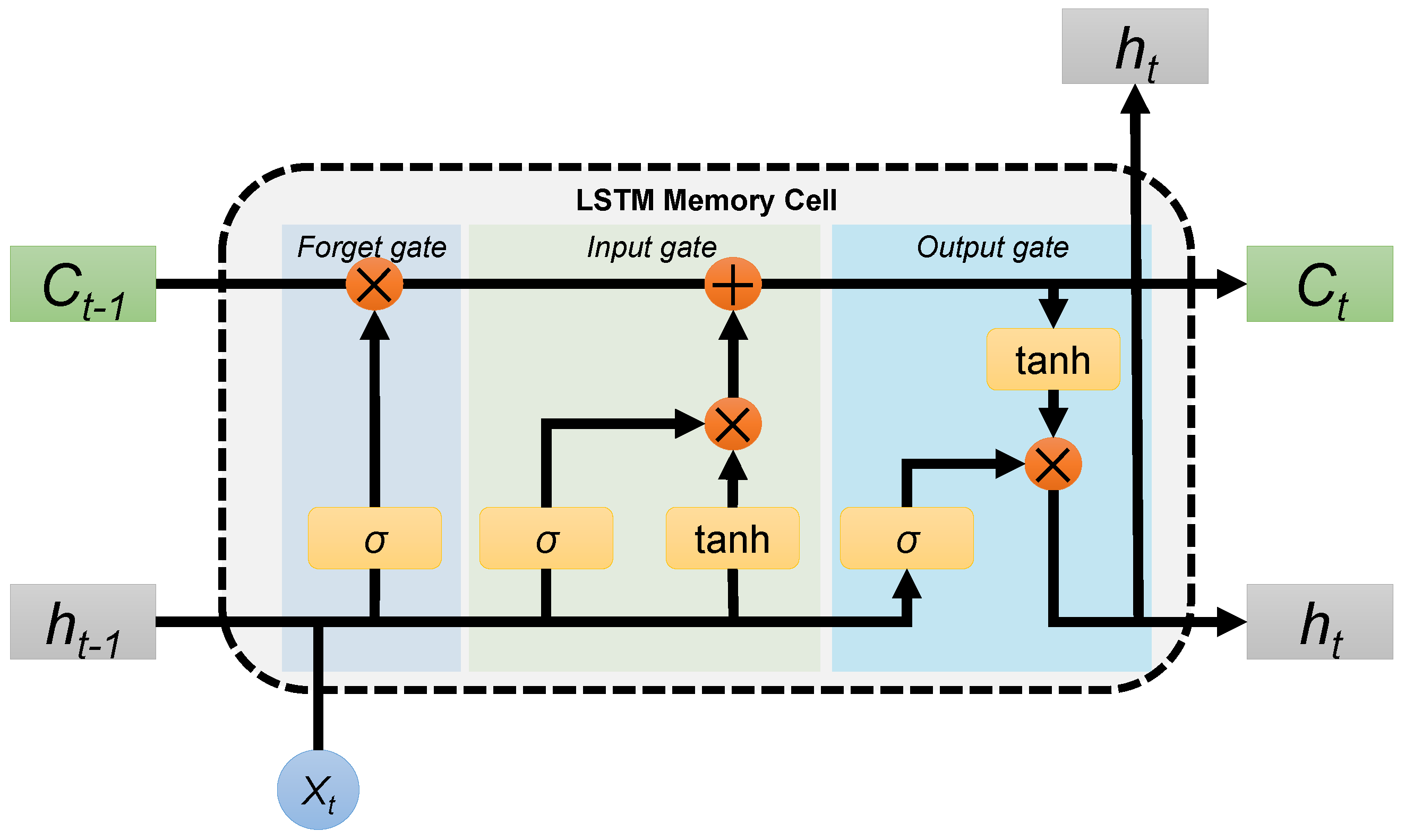

حافظه طولانی کوتاه مدت یا همان Long Short-Term Memory نوعی شبکه عصبی بازگشتی است که 3 گیت دارد و علکرد بهتری در حفظ داده های سری زمانی دارد.

Long Short-Term Memory (LSTM) یک نوع معماری شبکه عصبی بازگشتی (RNN) است که در زمینه یادگیری عمیق (Deep Learning) توجه زیادی به خود جلب کرده است. LSTM به طور خاص برای رفع محدودیتهای RNN های سنتی طراحی شده است که در تشخیص وابستگیهای بلندمدت در دادههای زمانی مشکل داشتند. با معرفی یک حافظه و چندین دروازه (Gate)، LSTM ها در کاربردهای مختلفی مانند پردازش زبان طبیعی، تشخیص گفتار و تحلیل سری زمانی بسیار کارآمد بودهاند.

برای درک اهمیت LSTM ها، لازم است با چالشهای مرتبط با RNN های سنتی آشنا شویم. RNN های سنتی با مشکل گرادیان ناپدید شونده (Vanishing Gradient) روبرو هستند، که در آن گرادیانهایی که به عقب میروند (Backpropagation)، به صورت نمایی کاهش مییابند. همچنین در برخی موارد، گرادیانها میتوانند به صورت نمایی (exponentially) افزایش یابند که منجر به آموزش ناپایدار میشود.

LSTM ها در سال 1997 توسط Sepp Hochreiter و Jürgen Schmidhuber به عنوان یک راه حل برای این مسائل معرفی شدند. معماری LSTM یک حافظه را در بر میگیرد که به شبکه امکان ذخیره و دسترسی به اطلاعات در طول مدت زمانی بلند مدت را میدهد. این حافظه یاد میگیرد که کدام اطلاعات باید نگهداری شود و کدام باید دور ریخته شود.

بلوک اصلی یک LSTM سلول حافظه (Memory Cell) است که توسط سه دروازه محافظت میشود: دروازه ورودی (Input Gate)، دروازه فراموشی (Forget Gate) و دروازه خروجی (Output Gate). هر دروازه از یک لایه شبکه عصبی سیگموئید (sigmoid) و یک عملیات ضرب نقطه به نقطه تشکیل شده است. لایه سیگموئید مقادیر بین 0 و 1 را تولید میکند که مقدار اطلاعاتی که از طریق آن عبور میکند را نشان میدهد. بر اساس ورودی، حافظه قبلی و متن مشخص می شود که کدام اطلاعات در این دروازهها باید بهروزرسانی یا بازنشانی شود.

دروازه ورودی مشخص میکند چقدر اطلاعات جدید باید در حافظه ذخیره شود. دروازه ورودی، ورودی فعلی و حالت مخفی (Hidden State) قبلی را ترکیب کرده و آن را از طریق تابع فعالساز (Activation Function) سیگموئید عبور می دهد. خروجی سپس برای کنترل بهروزرسانی حافظه، استفاده میشود.

دروازه فراموشی تصمیم میگیرد کدام اطلاعات باید از حافظه حذف شوند. این دروازه ورودی فعلی و حالت مخفی قبلی را در نظر میگیرد، آنها را از طریق تابع فعالسازی سیگموئید پردازش میکند و برای هر عنصر حافظه، مقداری بین 0 و 1 را تولید میکند. مقدار 0 به معنای کاملاً فراموش کردن اطلاعات است، در حالی که مقدار 1 به معنای کاملاً حفظ کردن آن است.

دروازه خروجی مقدار اطلاعاتی که باید بر اساس ورودی فعلی و حالت مخفی قبلی به عنوان خروجی داده شود را تعیین میکند. همچنین، از یک تابع فعالسازی سیگموئید برای تولید مقادیر بین 0 و 1 استفاده میکند. این مقادیر سپس با حافظه سلول ضرب میشوند تا خروجی نهایی تولید شود.

با استفاده از این دروازهها، LSTMها میتوانند اطلاعات را حفظ یا حذف کنند و بنابراین می توانند به یادگیری وابستگیهای بلندمدت در دادههای پیاپی بپردازند. این معماری به مدل امکان میدهد تا اطلاعات را برای مدت زمان طولانی، بدون تحت تأثیر قرار گرفتن از مشکلات گرادیان ناپدید شونده یا انفجاری به یاد داشته باشد.

موفقیت LSTM در زمینههای مختلف، میتواند به قابلیت آنها در کنترل دنبالههای ورودی با طول دلخواه و درک الگوهای پیچیده در بازههای زمانی بلند برگردد. در پردازش زبان طبیعی، LSTM ها به طور گسترده ای برای وظایفی مانند تحلیل احساس، ترجمه ماشینی و تولید متن استفاده شدهاند. از LSTMها در تحلیل سری زمانی نیز استفاده شده است تا قیمتهای سهام و الگوهای آب و هوا را پیشبینی کند.

همچنین برخی از کاربرد های LSTM در حوزه های مختلف را در زیر مشاهده می کنیم:

· پردازش زبان طبیعی (Natural Language Processing): LSTMها به طور گسترده ای برای وظایفی مانند تحلیل احساس، ترجمه ماشینی، تولید زبان، طبقهبندی متن و شناسایی نامگذاری مورد استفاده قرار میگیرند.

· تشخیص گفتار (Speech Recognition): LSTMها بهبودهای قابل توجهی در توصیف دقیق کلمات گفتاری نشان دادهاند که در سیستمهای تشخیص گفتار ارزشمند هستند.

· تحلیل سری زمانی (Time Series Analysis): LSTMها به طور معمول در تحلیل و پیشبینی دادههای سری زمانی مانند قیمت سهام، الگوهای آب و هوا، تقاضای انرژی و تشخیصهای پزشکی استفاده میشوند.

· توصیف تصاویر و ویدیوها (Image and Video Captioning): LSTMها در تولید شرح و توضیح تصاویر و ویدیوها بر اساس محتوای آنها استفاده میشوند.

· تشخیص دستخط (Handwriting Recognition): LSTMها به طور موثری در تشخیص و تفسیر متن دستخط استفاده میشوند.

· تولید موسیقی (Music Generation): LSTMها میتوانند الگوها را در توالیهای موسیقی یاد بگیرند و ترکیبهای موسیقی جدیدی تولید کنند.

· تشخیص ناهنجاری (Anomaly Detection): LSTMها میتوانند برای تشخیص ناهنجاری در توالیها مورد استفاده قرار گیرند، مانند شناسایی تراکنشهای تقلبی در دادههای مالی.

· تشخیص حرکات (Gesture Recognition): LSTMها در تشخیص و تفسیر حرکات در زبان اشاره یا تعامل انسان-کامپیوتر استفاده شدهاند.

· رباتیک (Robotics): LSTMها در سیستمهای رباتیک برای وظایفی مانند برنامهریزی حرکت، کنترل و اعمال نفوذ (manipulation) استفاده میشوند.

· نظارت بر سلامت (Health Monitoring): LSTMها میتوانند در تحلیل دادههای سری زمانی از دستگاههای پزشکی برای نظارت بر شرایط سلامت و پیشبینی مشکلات سلامت مورد استفاده قرار گیرند.

این موارد تنها چند مثال ساده از کاربردهای این نوع شبکه عصبی هستند و چون LSTMها چند منظوره هستند، میتوانند در زمینههای مختلف نیز استفاده شوند. به طور خلاصه، با پیشرفت تحقیقات در حوزه یادگیری عمیق، انتظار میرود LSTMها در پیشبرد هوش مصنوعی و پیشبینی نقش مهمی را ایفا کنند.

پست های مرتبط

حافظه طولانی کوتاه مدت

شبکه عصبی بازگشتی

یادگیری عمیق

هوش مصنوعی

پردازش زبان طبیعی

تشخیص گفتار

تحلیل احساس

ترجمه ماشینی

پیشبینی قیمت

گرادیان ناپدید شونده

برنامه نویسی هوش مصنوعی

برنامه نویس تیما

تیما فاطمه

پایتون

پایتون و هوش مصنوعی

Long Short

Term Memory

Vanishing Gradient

Backpropagation

Memory Cell

Input Gate

Forget Gate

Output Gate

Hidden State

LSTM

Natural Language Processing

Speech Recognition

Time Series Analysis

Image and Video Captioning

Music Generation

Robotics

Health Monitoring

Python

Programming

هوش مصنوعی

AI

machine learning

یادگیری ماشین

یادگیری عمیق

deep learning

شبکه های عصبی مصنوعی

ANN

Artificial Neural Network

Artificial Intelligence

نظرات :

سلام. ممنون از مطالبتون. میشه بفرمایید منابع این مطالب از کجا هست؟

_Time series Data.jpg)

_Text Summarization.jpg)

_MatplotLib.jpg)

_TensorFlow.jpg)

_Pytorch.jpg)

_pandas.jpg)

_Numerical Python.jpg)

_Intrusion Detection System.jpg)

_Distributed Denial of Service.jpg)

_DOS.jpg)

_Text Mining.jpg)

_NLP.jpg)

سلام. وقتتون بخیر سلامت باشید ChatGPT و Deep Learning by Ian Goodfellow و Chistio و https://www.geeksforgeeks.org/deep-learning-introduction-to-long-short-term-memory/ و https://www.analyticsvidhya.com/blog/2021/03/introduction-to-long-short-term-memory-lstm/